[시스템 설계] 1장 - 사용자 수에 따른 규모 확장

배울 내용: 한 명의 사용자를 지원하는 시스템 -> 몇백만 사용자를 지원하는 시스템 설계

Keyword: 규모 확장성

단일 서버

모든 컴포넌트가 단 한 대의 서버에서 실행되는 간단한 시스템부터 설계해보자

웹, 앱, 데이터베이스, 캐시 등이 전부 서버 한 대에서 실행된다

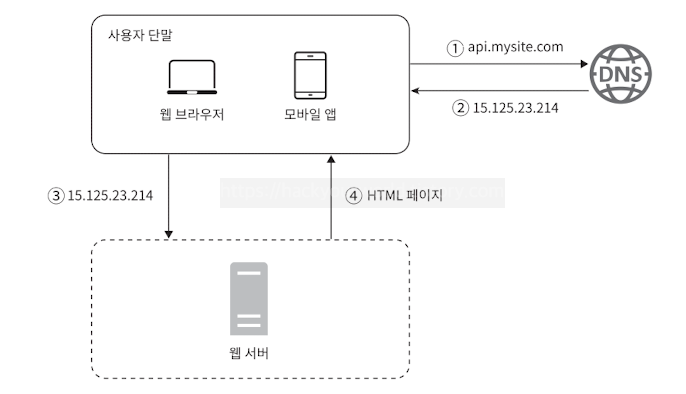

사용자 요청 처리 흐름

- 1. 사용자는 도메인 이름(api.mysite.com)을 이용해 웹사이트에 접속

이 접속을 위해서 도메인 이름을 도메인 이름 서비스(Domain Name Service, DNS)에 질의하여 IP 주소로 변환하는 과정 필요

DNS는 보통 제3 사업자(third party)가 제공하는 유료 서비스를 이용하게 되므로, 우리 시스템의 일부는 아님 - DNS 조회 결과로 IP 주소가 반환됨(그림의 웹 서버의 주소)

- 해당 IP 주소로 HTTP(HyperText Transfer Protocol) 요청이 전달됨

- 요청을 받은 웹 서버는 HTML 페이지나 JSON 형태의 응답 반환

요청은 두 가지 종류의 단말에서 온다; 웹 앱, 모바일 앱

- 웹 어플리케이션

비즈니스 로직, 데이터 저장 등을 처리하기 위해서는 서버 구현용 언어(자바, 파이썬 등)을 사용하고,

프레젠테이션 용으로는 클라이언트 구현용 언어(HTML, 자바스크립트 등)를 사용한다. - 모바일 앱

모바일 앱과 웹 서버 간 통신을 위해서는 HTTP 프로토콜을 이용

HTTP 프로토콜을 통해서 반환될 응답 데이터의 포맷으로는 보통 JSON(JavaScript Object Notation)이 그 간결함 덕에 널리 쓰인다.

데이터베이스

사용자가 늘면 서버 하나로는 충분하지 않아서 여러 서버를 두어야 함 -> 각각을 독립적으로 확장해 나갈 수 있음

- 웹/모바일 트래픽 처리 용도 -> 웹 계층 서버

- 데이터베이스용 -> 데이터 계층 서버

어떤 데이터베이스를 사용할 것인가?

전통적인 관계형 데이터베이스(relational database) or 비-관계형 데이터베이스

관계형 데이터베이스; 관계형 데이터베이스 관리 시스템(Relational Data-base Management System, RDBMS) 라고도 부름

ex) MySQL, 오라클 데이터베이스, PostgreSQL 등

자료를 테이블, 열(row), 칼럼(column)으로 표현

SQL을 사용하면 여러 테이블에 있는 데이터를 그 관계에 따라 조인(join)하여 합칠 수 있음

비 관계형 데이터베이스; NoSQL

ex) CouchDB, Neo4j, Cassandra, HBBase, Amazon DynamoDB 등

4가지 부류로 나눌 수 있음

- 키-값 저장소(key-value store)

- 그래프 저장소(graph store)

- 칼럼 저장소(column store)

- 문서 저장소(document store)

일반적으로 비-관계형 데이터베이스는 조인 연산을 지원하지 않는다

40년 이상 살아남아 잘 사용되어온 관계형 데이터베이스가 최선이라고 생각될 수 있다

아래와 같은 경우에는 비-관계형 데이터베이스가 바람직

- 아주 낮은 응답 지연시간(latency)가 요구됨

- 다루는 데이터가 비정형(unstructured)이라 관계형 데이터가 아님

- 데이터(JSON, YAML, XML 등)를 직렬화하거나(serialize) 역직렬화(deserialize) 할 수 있기만 하면 됨

- 아주 많은 양의 데이터를 저장할 필요가 있음

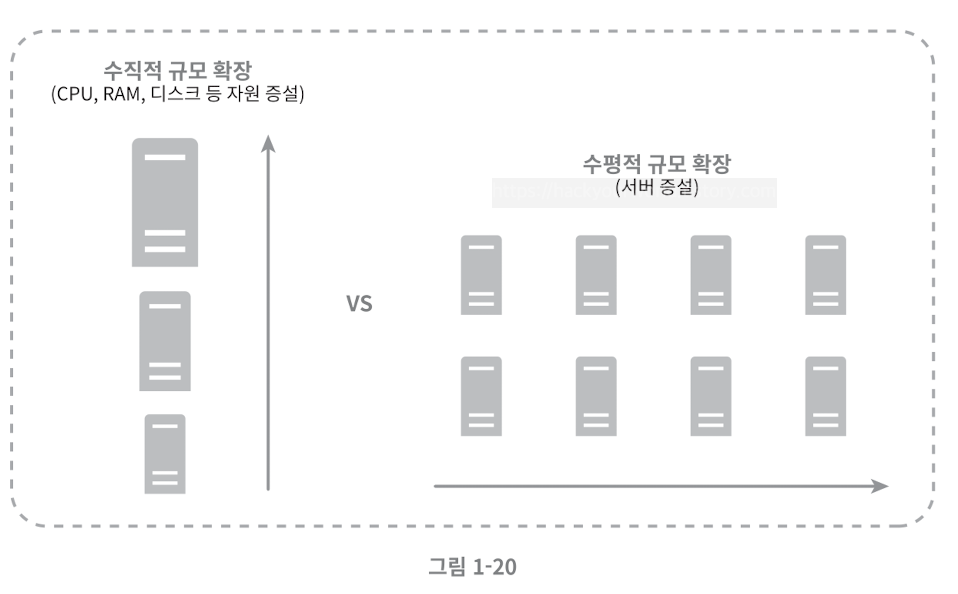

수직적 규모 확장 vs 수평적 규모 확장

스케일 업(scale up)

= 수직적 규모 확장(vertical scaling)

- 서버에 고사양 자원(더 좋은 CPU, 더 많은 RAM 등)을 추가하는 행위

- 서버로 유입되는 트래픽 양이 적을 때, 좋은 선택

- 장점

- 단순함

- 단점:

- 수직적 규모 확장에는 한계가 있다. 한 대의 서버에 CPU나 메모리를 무한대로 증설할 방법은 없다

- 자동 복구(failover) 방안이나 다중화(redundancy) 방안을 제시하지 않음. 서버에 장애가 발생하면 웹사이트/앱은 완전히 중단

스케일 아웃(scale out)

= 수평적 규모 확장

- 더 많은 서버를 추가하여 성능을 개선하는 행위(1대 서버 -> n대 서버)

- 대규모 어플리케이션 지원에 좋은 선택

앞서 본 설계

- 사용자가 웹 서버에 바로 연결됨

- 웹 서버가 다운되면 사용자는 웹 사이트에 접속할 수 없음

- 너무 많은 사용자가 접속하여 웹 서버가 한계 상황에 도달하게 되면, 응답 속도가 느려지거나 서버 접속이 불가능해질 수도 있음

-> 부하 분산기 or 로드밸런서(load balancer)

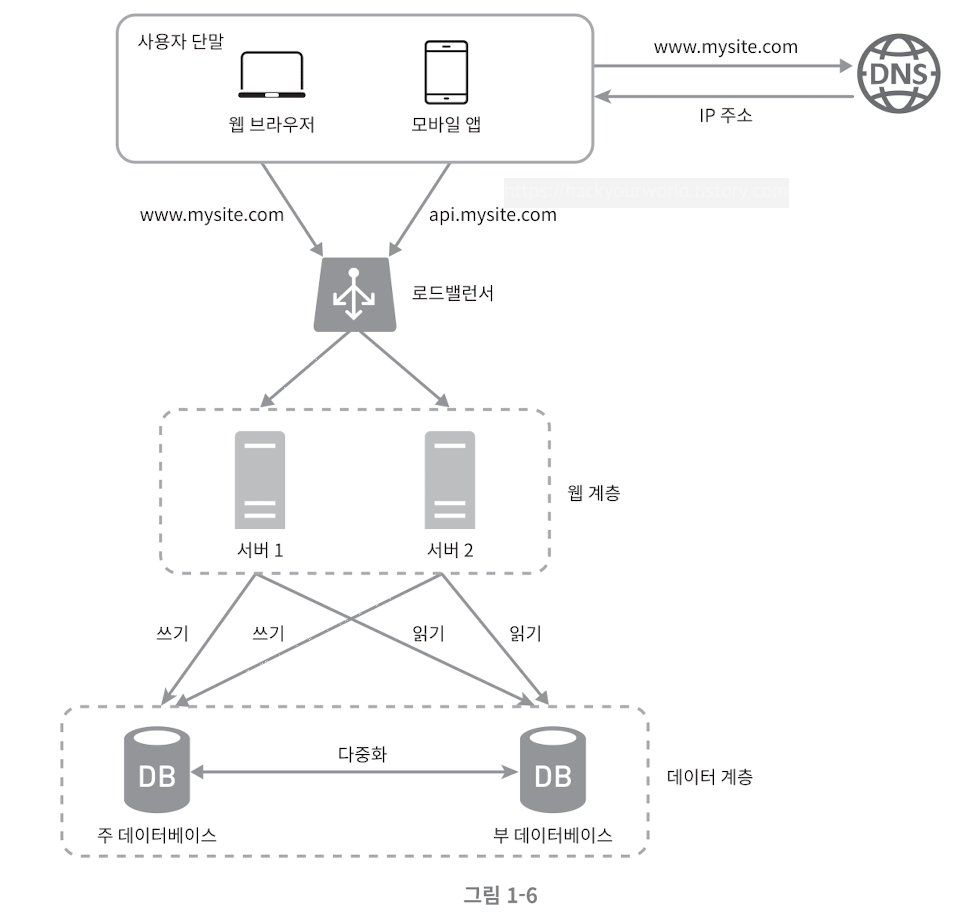

로드 밸런서

부하 분산 집합(load balancing set)에 속한 웹서버들에게 트래픽 부하를 고르게 분산하는 역할

사용자는 로드밸런서의 공개 IP 주소(public IP address)로 접속

-> 웹 서버는 클라이언트의 접속을 직접 처리하지 않는다

-> 더 나은 보안을 위해, 서버 간 통신에는 사설 IP 주소(private IP address)가 이용된다

사설 IP 주소: 같은 네트워크에 속한 서버 사이의 통신에만 쓰일 수 있는 IP 주소로, 인터넷을 통해서는 접속할 수 없음

(로드밸런서는 웹 서버와 통신하기 위해 사설 주소 이용)

부하 분산 집합에 또 하나의 웹서버를 추가하고 나면,

장애를 자동 복구하지 못하는 문제(no failover) 해소 -> 웹 계층의 가용성(availability)은 향상

- 서버 1이 다운되면(offline) 모든 트래픽은 서버 2로 전송

-> 웹 사이트 전체가 다운되는 일 방지, 부하를 나누기 위해 새로운 서버 추가 가능 - 웹 사이트로 유입되는 트래픽이 가파르게 증가하면 서버 두대로도 트래픽 감당 불가! 로드 밸런서가 있으므로 우아하게 대처 가능

-> 웹 서버 계층에 더 많은 서버를 추가하기만 하면됨(로드밸런스가 자동적으로 트래픽 분산)

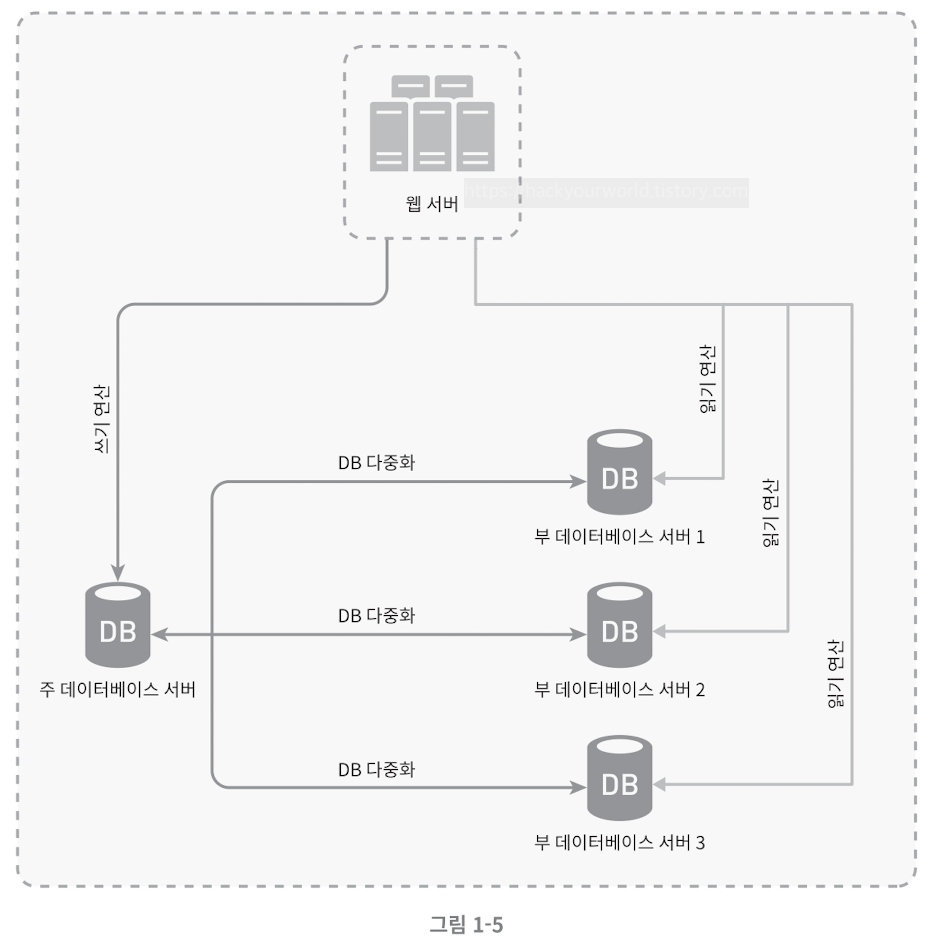

데이터베이스 다중화

현재 하나의 데이터베이스 서버 -> 장애의 자동복구, 다중화 지원 X

"많은 데이터베이스 관리 시스템이 다중화 지원.

보통은 서버 사이에 주(master)-부(slave) 관계를 설정, 데이터 원본은 주 서버에, 사본은 부 서버에 저장"

쓰기 연산(write operation)은 마스터에서만 지원

부 데이터베이스는 주 데이터베이스로부터 그 사본 전달 받으며, 읽기 연산(read operation)만 지원

ex) insert, delete, update 등 데이터베이스를 변경하는 명령들 -> 주 데이터베이스로만 전달

대부분의 애플리케이션은 읽기 연산의 비중 >>>>>> 쓰기 연산

=> 통상 부 데이터베이스의 수가 더 많음

데이터베이스 다중화 장점

- 더 나은 성능: 주-부 다중화 모델에서 모든 데이터 변경 연산은 주 데이터베이스 서버 / 읽기 연산은 부 데이터베이스 서버들로 분산

병렬로 처리될 수 있는 질의(query)의 수가 늘어나므로, 성능이 좋아짐 - 안정성(reliability): 자연 재해 등의 이유로 데이터베이스 서버 가운데 일부가 파괴되어도 데이터는 보존

지역적으로 떨어진 여러 장소에 데이터를 다중화 시켜놓을 수 있음! - 가용성(availability): 데이터를 여러 지역에 복제, 하나의 데이터베이스 서버에 장애가 발생하더라도

다른 서버에 있는 데이터를 가져와 계속 서비스할 수 있음

데이터베이스 서버 가운데 하나가 다운되면?

그림 1-5 설계는 이런 상황 감당 가능

- 부 서버가 한 대 뿐인데 다운된 경우,

읽기 연산은 한시적으로 모두 주 데이터베이스로 전달

즉시, 새로운 부 데이터베이스 서버가 장애 서버 대체 - 부 서버가 여러 대인 경우,

읽기 연산은 나머지 부 데이터베이스 서버들로 분산, 새로운 부 데이터베이스 서버가 장애 서버 대체 - 주 데이터베이스 서버가 다운된 경우,

한대의 부 데이터베이스만 있는 경우, 해당 부 데이터베이스 서버가 새로운 주 서버 -> 모든 데이터베이스 연산은 일시적으로 새로운 주 서버상에서 수행 -> 새로운 부서버가 추가될 것 - (production 환경에서 벌어지는 복잡한일!) 부 서버에 보관된 데이터가 최신 상태가 아닐 경우?!

없는 데이터는 복구 스크립트(recovedry script)를 돌려서 추가

다중 마스터(multi-masters) or 원형 다중화(circular replication) 방식 도입 필요

-> 구성이 복잡 + 별도 공부 추천

로드밸런서 + 데이터베이스 다중화 고려한 설계

- 사용자는 DNS로부터 로드밸런서의 공개 IP 주소를 받는다

- 사용자는 해당 IP 주소를 사용해 로드밸런서에 접속한다

- HTTP 요청은 서버 1이나 서버 2로 전달된다

- 웹 서버는 사용자의 데이터를 부 데이터베이스 서버에서 읽는다

- 웹 서버는 데이터 변경 연산은 주 데이터베이스로 전달한다. 데이터 추가, 삭제, 갱신 연산 등이 해당

이제 웹 계층, 데이터 계층에 대한 충분한 이해 끝!

응답시간(latency)를 개선해보자!

=> 캐시(cache)를 붙이고 정적 콘텐츠를 콘텐츠 전송 네트워크(Content Delivery Network, CDN)로 옮기면 개선 가능

캐시

값비싼 연산 결과 or 자주 참조되는 데이터를 메모리 안에 두고, 뒤 이은 요청이 보다 빨리 처리될 수 있도록 하는 저장소

ex) 웹 페이지를 새로고침할 때마다 표시할 데이터를 가져오기 위해 한 번 이상의 데이터베이스 호출 발생

애플리케이션 성능 = 데이터베이스를 얼마나 자주 호출하느냐에 크게 좌우

-> 캐시는 해당 문제 완화 가능

캐시 계층

캐시 계층(cache tier): 데이터가 잠시 보관되는 곳, DB보다 훨씬 빠름

별도의 캐시 계층을 두면,

- 성능 개선

- 데이터 베이스 부하 감소

- 캐시 계층의 규모를 독립적으로 확장 시키기 가능

1. 요청 받은 웹 서버는 캐시에 응답이 저장되어있는지 확인

2. If 저장, 해당 데이터를 클라이언트에 반환 / 없으면, 데이터베이스 질의를 통해 데이터를 찾아 캐시에 저장한 뒤 클라이언트에 반환

=> 읽기 주도형 캐시 전략(read-through caching strategy)

캐시할 데이터 종류, 크기, 액세스 패턴에 맞는 캐시 전략 선택 -> [6] 참조

캐시 서버들은 일반적으로 널리 쓰이는 프로그래밍 언어로 API 제공 -> 이용 간단

EX) memcached API의 전형적 사용 예

SECONDS = 1

cache.set('myKey', 'hi there', 3600 * SECONDS)

cache.get('myKey')

캐시 사용 시 유의할 점

- 캐시는 어떤 상황에 바람직?

데이터 갱신은 자주 일어나지 않지만, 참조는 빈번하게 일어난다면 고려해볼만 함! - 어떤 데이터를 캐시에 두어야 함?

캐시는 휘발성 메모리에 둠 -> 영속적으로 보관할 데이터를 캐시에 두는 것은 바람직하지 않음

ex) 캐시 서버가 재시작되면, 캐시 내의 모든 데이터는 사람. 중요한 데이터는 지속적 저장소(persistent data store)에 두자 - 캐시에 보관된 데이터는 어떻게 만료(expire)?

정책을 마련해두는게 좋은 습관!

만료된 데이터는 캐시에서 삭제 되어야함. 만료 정책 없으면 데이터는 계속 캐시에 남음

만료 기간이 너무 짧다면, 데이터베이스를 너무 자주 읽게 됨

너무 길면, 원본과 차이가 날 가능성 - 일관성(consistency)은 어떻게 유지?

일관성: 데이터 저장소의 원본과 캐시 내의 사본이 같은지 여부

저장소의 원본을 갱신하는 연산, 캐시를 갱신하는 연산이 단일 트랜잭션으로 처리 안되는 경우, 일관성 깨짐!!!!

여러 지역에 걸쳐 시스템 확장 -> 캐시와 저장소 사이의 일관성 유지 어려움

페이스북에서 내놓은 논문 <Scaling Memcache at Facebook> 참고 - 장애에는 어떻게 대처?

캐시 서버 1대 -> 해당 서버는 단일 장애 지점(Single Point of Failure, SPOF)가 되어버릴 가능성

단일 장애 지점 = "어떤 특정 지점에서의 장애가 전체 시스템의 동작을 중단시켜버릴 수 있는 경우"

SPOF를 피하려면, 여러 지역에 걸쳐 캐시 서버 분산

- 캐시 메모리는 얼마나 크게?

너무 작으면, 액세스 패턴에 따라 데이터가 너무 자주 캐시에서 밀려나버려(eviction) -> 캐시 성능 저하

방법: 캐시 메모리를 과할당(overprovision) -> 캐시에 보관될 데이터가 갑자기 늘어났을 때 생길 문제 방지 - 데이터 방출(eviction) 정책은 무엇?

캐시가 꽉 차버리면, 추가로 데이터 넣을 경우 기존 데이터 내보내야 함 = 캐시 데이터 방출 정책

LRU(Least Recently Used - 마지막으로 사용된 시점이 가장 오래된 데이터를 내보내는 정책)

LFU(Least Frequently Used - 사용된 빈도가 가장 낮은 데이터 내보내는 정책)

FIFO(First In First Out - 가장 먼저 캐시에 들어온 데이터를 가장 먼저 내보내는 정책)

콘텐츠 전송 네트워크(CDN)

정적 콘텐츠를 전송하는데 쓰이는, 지리적으로 분산된 서버의 네트워크

이미지, 비디오, CSS, JS 파일 등 캐시

동적 콘텐츠 캐싱

: 요청 경로(request path), 질의 문자열(query string), 쿠키(cookie), 요청 헤더(request header) 등의 정보에 기반하여 HTML 페이지 캐시

[9] 참고

어떤 사용자가 웹사이트 방문, 그 사용자에게 가장 가까운 CDN 서버가 정적 콘텐츠 전달

사용자가 CDN 서버로부터 멀수록, 웹사이트는 천천히 로드

1. 사용자 A가 이미지 URL을 이용해 image.png에 접근. URL의 도메인은 CDN 서비스 사업자가 제공

아래의 두 URL은 클라우드 프론트(Cloudfront)와 아카마이(Akamai) CDN이 제공하는 URL예제

- https://mysite.cloudfront.net/logo.jpg

- https://myste.com/image-manager/img/logo.jpg

2. CDN 서버의 캐시에 해당 이미지가 없는 경우, 서버는 원본(origin)서버에 요청하여 파일을 가져온다.

원본 서버는 웹서버일 수도, 아마존(Amazon) S3 같은 온라인 저장소일수도

3. 원본 서버가 파일을 CDN 서버에 반환. 응답의 HTTP 헤더에는 해당 파일이 얼마나 오래 캐시될 수 있는지를 설명하는 TTL(Time-To-Live) 값이 들어 있음

4. CDN 서버는 파일을 캐시하고 사용자 A에게 반환한다. 이미지는 TTL에 명시된 시간이 끝날 때까지 캐시

5. 사용자 B가 같은 이미지에 대한 요청을 CDN 서버에 요청한다.

6. 만료되지 않은 이미지에 대한 요청은 캐시를 통해 처리된다.

CDN 사용시 고려해야 할 사항

- 비용: CDN은 보통 제3 사업자(third-party providers)에 의해 운영, 우리는 CDN으로 들어가고 나가는 데이터 전송양에 따라 요금을 내게 된다. 자주 사용되지 않은 콘텐츠를 캐싱하는 것은 이득이 크지 않으므로, CDN에서 제외 고려

- 적절한 만료 시한 설정: 시의성이 중요한(time-sensitive) 콘텐츠의 경우 만료 시점을 잘 정해야 함.

너무 길면 콘텐츠의 신선도는 떨어지고, 너무 짧으면 원본 서버에 번번히 접속하게 되어서 좋지 않음 - CDN 장애에 대한 대처 방안: CDN 자체가 죽었을 경우 웹사이트/애플리케이션이 어떻게 동작해야하는지 고려

ex) 일시적으로 CDN이 응답하지 않을 경우, 해당 문제를 감지하여 원본 서버로부터 직접 콘텐츠를 가져오도록 클라이언트를 구성하는게 필요 - 콘텐츠 무효화(invalidation) 방법: 아직 만료되지 않은 콘텐츠라 하더라도 아래 방법 가운데 하나를 쓰면 CDN에서 제거 가능

- CDN 서비스 사업자가 제공하는 API를 이용하여 콘텐츠 무효화

- 콘텐츠의 다른 버전을 서비스하도록 오브젝트 버저닝(object versioning) 이용

콘텐츠의 새로운 버전을 지정하기 위해서는 URL 마지막에 버전 번호를 인자로 주면 됨.

ex) image.png?v=2

CDN과 캐시가 추가된 설계

변화된 부분

1. 정적 콘텐츠(JS, CSS, 이미지 등)는 더 이상 웹 서버를 통해 서비스하지 않으며, CDN을 통해 제공하여 더 나은 성능을 보장

2. 캐시가 데이터베이스 부하를 줄여준다.

무상태(stateless) 웹 계층

이제 웹 계층을 수평적으로 확장하는 방법을 고민해볼 순서!

이를 위해, 상태 정보(사용자 session 데이터와 같은)를 웹 계층에서 제거해야함

-> 상태 정보를 RDB나 NoSQL 같은 지속성 저장소에 보관하고, 필요할 때 가져오도록 함

=> 이렇게 구성된 웹 계층을 무상태 웹계층

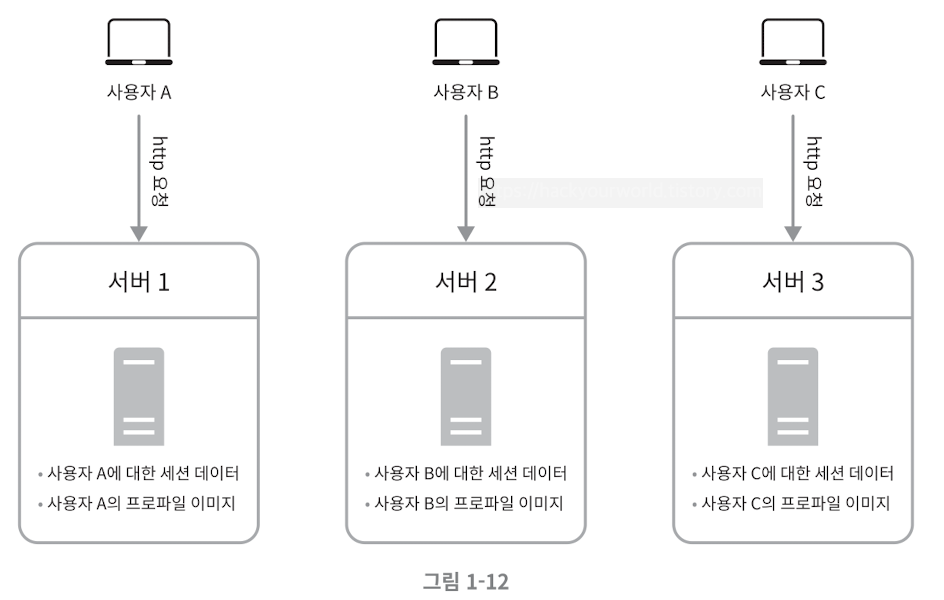

상태 정보 의존적인 아키텍처

상태정보를 보관하는 서버 vs 그렇지 않은 서버 차이

상태 정보를 보관하는 서버: 클라이언트 정보, 즉 상태를 유지하여 요청들 사이에 공유되도록 함

무상태 서버에는 이런 장치 없음

사용자 A를 인증하기 위해 HTTP 요청은 반드시 서버1로 전송되어야함

요청이 서버2로 전송되면 인증은 실패. 사용자 A에 관한 데이터는 보관되어 있지 않기 때문!

문제는 같은 클라이언트로부터 요청은 항상 같은 서버로 전송되어야 한다는 것!

대부분의 로드밸런서가 이를 지원하기 위해 고정 세션(sticky session)이라는 기능 제공, 이는 로드밸런서에 부담 줌

로드밸런서 뒷단에 서버를 추가하거나 제거하기도 까다로워짐 -> 서버의 장애 처리하기 복잡해짐

무상태 아키텍처

사용자로부터의 HTTP 요청은 어떤 웹 서버로도 전달될 수 있다.

웹 서버는 상태 정보가 필요할 경우 공유 저장소(shared storage)로부터 데이터를 가져온다!

-> 상태 정보는 웹 서버로부터 물리적으로 분리되어 있음

=> 이런 구조는 단순하고, 안정적이며, 규모 확장이 쉽다.

무상태 웹 계층을 갖도록 기존 설계 변경

세션 데이터를 웹 계층에서 분리하고 지속성 데이터 보관소에 저장하도록 함

이 공유 저장소는 RDB일수도, Memcached/Redis 같은 캐시 시스템일 수도, NoSQL 일 수도 있다.

여기서는 NoSQL을 사용 -> 규모 확장이 간편해서

(1) 자동 규모 확장(autoscaling)

: 트래픽 양에 따라 웹 서버를 자동으로 추가하거나 삭제하는 기능

=> 상태 정보가 웹 서버들로부터 제거되었으므로, 트래픽 양에 따라 웹 서버를 넣거나 빼기만 하면 자동으로 규모를 확장할 수 있게 됨!!

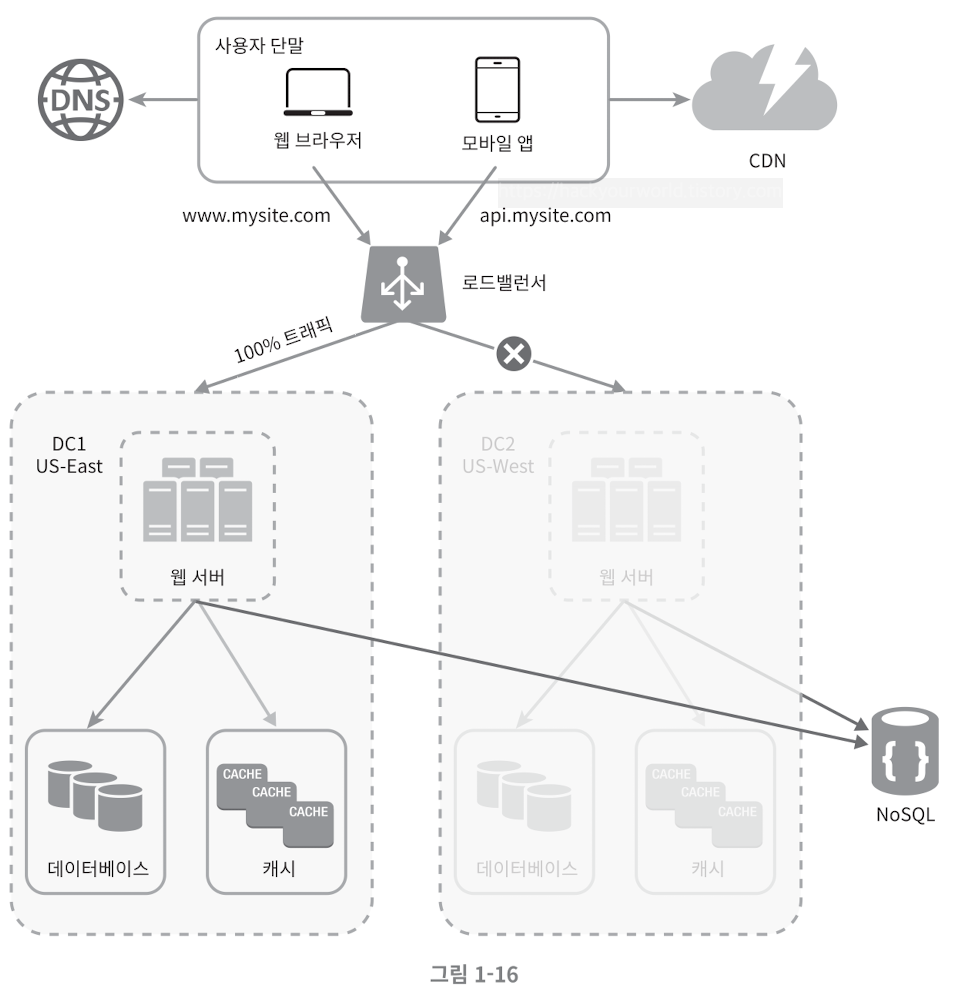

데이터 센터

웹사이트가 매우 빨리 성장. 전 세계 사용자들의 이목을 받는 시점

-> 가용성을 높이고 전 세계 어디서도 쾌적하게 사용할 수 있도록하기 위해서는 데이터 센터(data center) 지원 필수

장애가 없는 상황에서 사용자는 가장 가까운 데이터 센터로 안내됨

= 지리적 라우팅(geoDNS-routing 또는 geo-routing)

지리적 라우팅에서의 geoDNS는 사용자의 위치에 따라 도메인 이름을 어떤 IP 주소로 변환할지 결정할 수 있도록 해주는 DNS 서비스

이 예제의 경우, 그 결과로 x% 사용자는 US-East 센터로, (100-x)%의 사용자는 US-West 센터로 안내됨

이들 데이터 센터 중 하나에 심각한 장애가 발생하면 모든 크래픽은 장애가 없는 데이터 센터로 전송됨

이 사례와 같은 다중 데이터센터 아키텍처를 만들려면 해결해야하는 몇 가지 기술적 난제

- 트래픽 우회: 올바른 데이터 센터로 트래픽을 보내는 효과적인 방법을 찾아야함

GeoDNS는 사용자에게서 가장 가까운 데이터센터로 트래픽을 보낼 수 있도록 함 - 데이터 동기화(synchronization): 데이터 센터마다 별도의 데이터베이스를 사용하고 있는 상황이라면, 장애가 복구되어(failover) 트래픽이 다른 데이터베이스로 우회된다고 해도, 해당 데이터센터에는 찾는 데이터가 없을 수 있음.

이런 상황을 막는 보편적 전략 -> 여러 데이터 센터에 걸쳐 다중화하는 것

ex) 넷플릭스가 여러 데이터센터에 걸쳐 어떻게 데이터를 다중화하는지 관심이 있다면[11] - 테스트와 배포(deployment): 여러 데이터 센터를 사용하도록 시스템이 구성된 상황이라면 웹 사이트 또는 App을 여러 위치에서 테스트해보는 것이 중요 -> 자동화된 배포 도구는 모든 데이터 센터에 동일한 서비스가 설치되도록 하는데 중요한 역할

메세지 큐

시스템을 더 큰 규모로 확장하기 위해서는 시스템의 컴포넌트를 분리하여, 각기 독립적으로 확장할 수 있도록 해야 함.

메세지 큐(message queue)는 많은 실제 분산 시스템이 이 문제를 풀기 위해 채용하고 있는 핵심적 전략 가운데 하나

메세지 큐: 메세지의 무손실을 보장하는 비동기 통신을 지원하는 컴포넌트

*메세지 무손실(durability): 메세지 큐에 일단 보관된 메세지는 소비가자 꺼낼 때 까지 안전히 보관된다는 특성

*비동기 통신: asynchronous communication

-> 메세지의 버퍼 역할을 하며, 비동기적으로 전송함

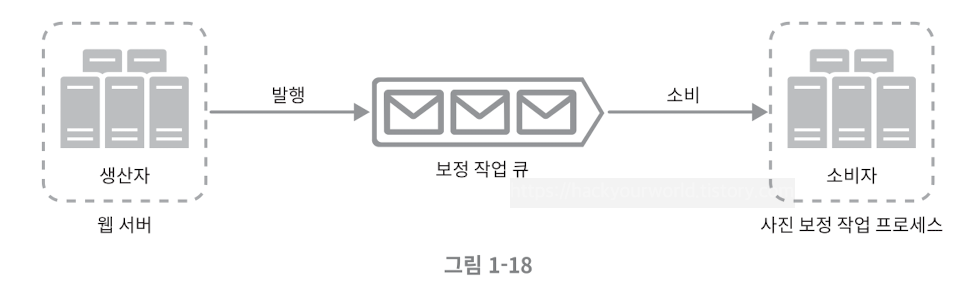

메세지 큐의 기본 아키텍처

생산자 또는 발행자(producer/publisher)라고 불리는 입력 서비스가 메세지를 만들어 메세지 큐에 발행(publish)한다.

큐에는 보통 소비자 혹은 구독자(consumer/subscriber)라 불리는 서비스 혹은 서버가 연결되어 있는데,

메세지를 받아 그에 맞는 동작을 수행하는 역할을 함

메세지 큐를 이용하면,

서비스 또는 서버 간 결합이 느슨해져서, 규모 확장성이 보장되어야하는 안정적 어플리케이션 구성하기에 좋음

생산자는 소비자 프로세스가 다운되어 있어도 메세지를 발행할 수 있고,

소비자는 생산자 서비스가 가용한 상태가 아니더라도 메세지를 수신할 수 있음

ex) 이미지의 크로핑(cropping), 샤프닝(sharpening), 블러링(blurring) 등을 지원하는 사진 보정 애플리케이션

보정은 시간이 오래 걸릴 수 있는 프로세스이므로 비동기적으로 처리하면 편리함.

웹 서버는 사진 보정 작업(job)을 메세지 큐에 넣는다.

사진 보정 작업(worker) 프로세스들은 이 작업을 메세지 큐에서 꺼내어 비동기적으로 완료한다.

-> 생산자와 소비자 서비스의 규모는 각기 독립적으로 확장할 수 있음

큐의 크기가 커지면 더 많은 작업 프로세스를 추가해야 처리 시간을 줄일 수 있음.

But, 큐가 거의 항상 비어있는 상태라면, 작업 프로세스 수는 줄일 수 있음

로그, 메트릭 그리고 자동화

몇 개 서버에서 실행되는 소규모 웹사이트에서는 로그, 메트릭(metric), 자동화(automation) 같은 것을 하면 좋지만 꼭 할 필요는 없었음

웹사이트와 함께 사업 규모가 커지고 나면, 그런 도구에 필수적으로 투자해야함!

로그

에러 로그를 모니터링하는 것은 중요함. 시스템의 오류와 문제들을 보다 쉽게 찾아낼 수 있도록 하기 때문.

에러 로그는 서버 단위로 모니터링 할 수도 있지만, 로그를 단일 서비스로 모아주는 도구를 활용하면 더 편리하게 검색, 조회 가능

메트릭

메트릭을 잘 수집하면 사업 현황에 관한 유용한 정보를 얻을 수 있고, 시스템의 현재 상태를 손쉽게 파악할 수 있다.

특히 유용한 메트릭

- 호스트 단위 메트릭: CPU, 메모리, 디스크 I/O에 관한 메트릭 등

- 종합(aggregated) 메트릭: 데이터베이스 계층의 성능, 캐시 계층의 성능 등

- 핵심 비즈니스 메트릭: 일별 능동 사용자(daily active user), 수익(revenue), 재방문(retention) 등

자동화

시스템이 크고 복잡해지면 생산성을 높이기 위해 자동화 도구를 활용해야 함

가령 지속적 통합(continuous integration; CI)을 도와주는 도구를 활용하면 개발자가 만드는 코드가 어떤 검증 절차를 자동으로 거치도록 할 수 있어서 문제를 쉽게 감지할 수 있음

이 외에도 빌드, 테스트, 배포 등의 절차를 자동화할 수 있어서 개발 생산성을 크게 향상시킬 수 있음

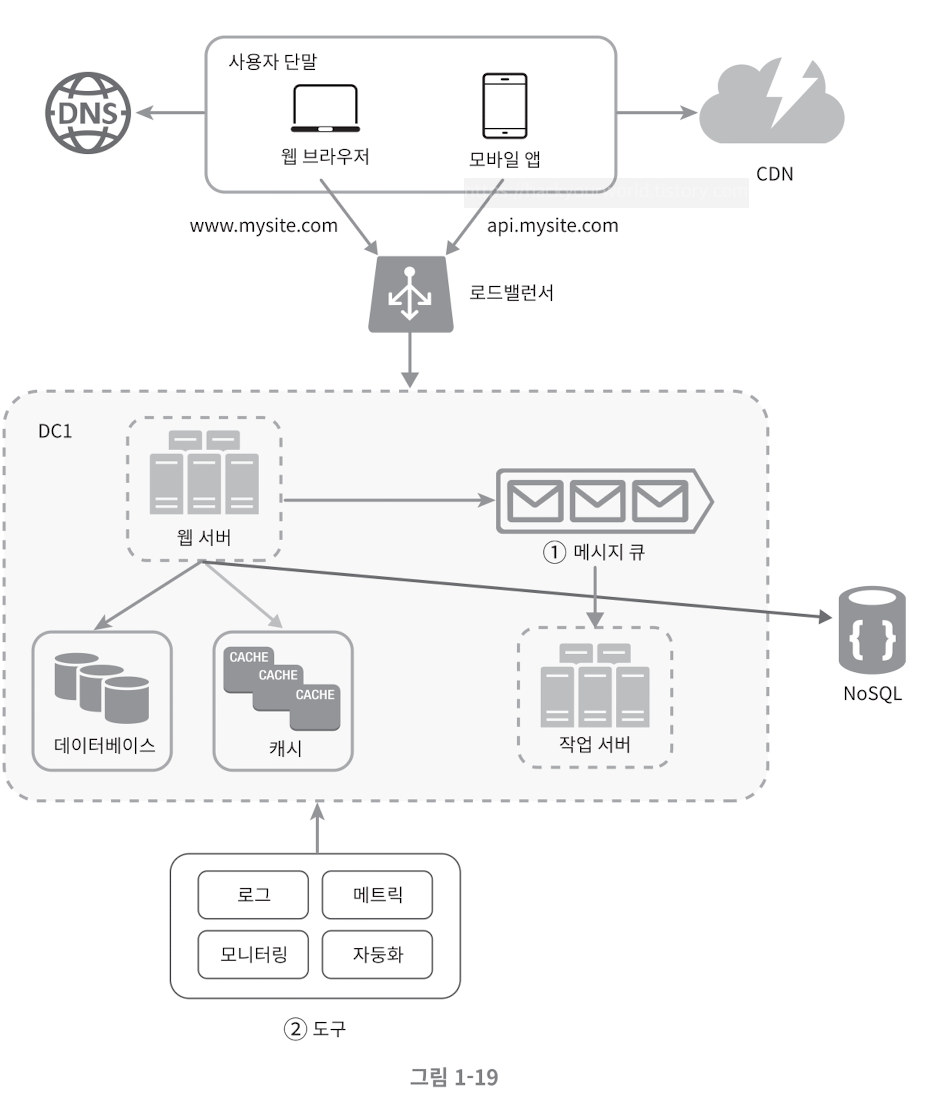

메세지 큐, 로그, 메트릭, 자동화를 반영하여 수정한 설계안

하나의 데이터센터만 그림

1. 메세지 큐는 각 컴포넌트가 보다 느슨히 결합(loosely coupled) 될 수 있도록 하고, 결함에 대한 내성을 높임

2. 로그, 모니터링, 메트릭, 자동화 등을 지원하기 위한 장치 추가

데이터베이스의 규모 확장

저장할 데이터가 많아지면 데이터베이스에 대한 부하도 증가 -> 데이터베이스 증설 방법 필요

데이터베이스 규모 확장의 두가지 방법; 수직적 규모 확장법, 수평적 규모 확장법

수직적 확장

= scale up

기존 서버에 더 많은, 또는 고성능의 자원(CPU, RAM, 디스크 등)을 증설하는 방법

ex) 아마존 AWS의 RDS(Relational Database Service)는 24TB RAM을 갖춘 서버도 상품으로 제공하고 있음

이 정도 수준의 고성능 데이터베이스 서버는 많은 양의 데이터를 보관하고 처리할 수 있음

ex) 스택오버플로는 2013년 한 해 동안 방문한 천만명 사용자 전부를 단 한 대의 마스터 데이터베이스로 처리함

약점

- 데이터베이스 서버 하드웨어에는 한계가 있으므로 CPU, RAM 등을 무한 증설할 수 없음 -> 사용자가 늘어나면 한 대 서버로는 결국 감당하기 어렵게 됨

- SFOF(Single Point of Failure)로 인한 위험성이 큼

- 비용이 많이 든다. 고성능 서버로 갈수록 가격이 올라가기 마련

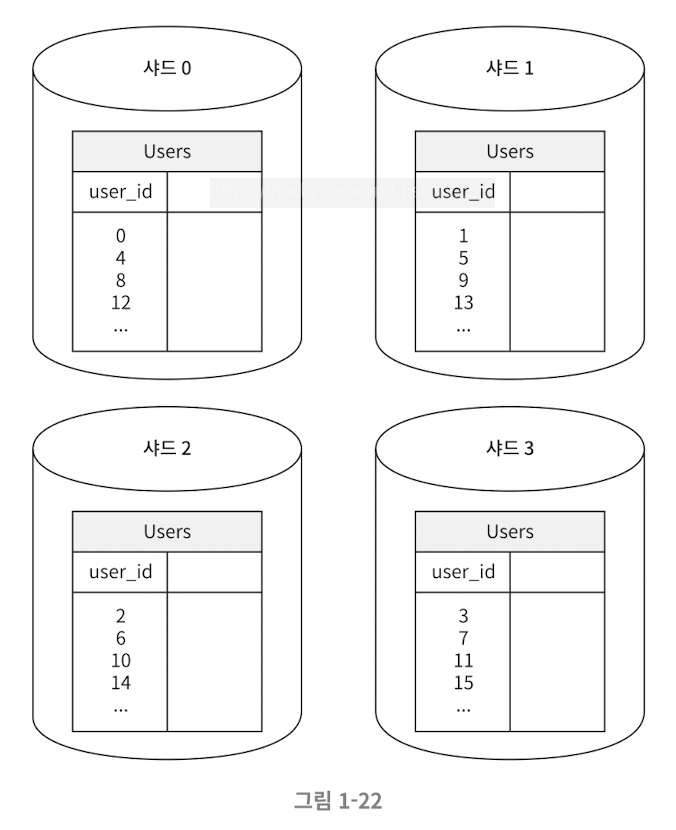

수평적 확장

= sharding

더 많은 서버를 추가함으로써 성능을 향상시킬 수 있도록 함

샤딩은 대규모 데이터베이스를 샤드(shard)라고 부르는 작은 단위로 분할하는 기술

모든 샤드는 같은 스키마를 쓰지만, 샤드에 보관되는 데이터 사이에는 중복이 없다.

user_id % 4를 해시 함수로 사용하여 데이터가 보관되는 샤드를 정한다.

결과가 0이면 0번 샤드, 1번이면 1번 샤드에 보관

샤딩 전략을 구현할 때 고려해야할 가장 중요한 것: 샤딩 키(sharding key)를 어떻게 정하느냐

샤딩 키 = 파티션 키(partition key): 데이터가 어떻게 분산될지 정하는 하나 이상의 칼럼으로 구성

ex) 그림 1-22의 경우 샤딩 키는 user_id

샤딩 키를 통해 올바른 데이터베이스에 질의를 보내어 데이터 조회/변경을 처리하므로 효율 높임

샤딩 키를 정할 때는 데이터를 고르게 분할할 수 있도록 하는게 가장 중요

샤딩은 데이터베이스 규모 확장을 실현하는 훌륭한 기술

샤딩 도입 시 고려해야할 사항

- 데이터의 재 샤딩(resharding): 샤드 소진(shard exhaustion)이라고도 부르는 아래 현상이 발생하면 샤드키를 계산하는 함수를 변경, 데이터를 재배치해야 함 -> 5장에서 다룰 안정 해시(consistent hashing) 기법으로 이 문제 해결 가능

재 샤딩은 다음과 같은 경우에 필요- (1) 데이터가 너무 많아져서 하나의 샤드로는 더 이상 감당하기 어려울 때

- (2) 샤드 간 데이터 분포가 균등하지 못하여 어떤 샤드에 할당된 공간 소모가 다른 샤드에 비해 빨리 진행될 때

- 유명 인사(celebrity) 문제: 핫스팟 키(hotspot key) 문제라고도 부르는데, 특정 샤드에 질의가 집중되어 서버에 과부하가 걸리는 문제 -> 해당 샤드에는 read 연산 때문에 과부하가 걸리게될 것.

유명인사들에 각각 샤드를 하나씩 할당 or 더 잘게 샤드를 쪼개야할 수도 있음 - 조인과 비정규화(join and de-normalization): 하나의 데이터베이스를 여러 샤드 서버로 쪼개고 나면, 여러 샤드에 걸친 데이터를 조인하기가 힘들어짐

-> 데이터를 비정규화하여 하나의 테이블에서 질의가 수행될 수 있도록 함

데이터베이스 샤딩을 적용한 아키텍처

백만 사용자, 그 이상

시스템의 규모를 확장하는 것은 지속적이고 반복적(iterative)인 과정

이번 장에서 다룬 내용을 반복하다보면 우리는 원하는 규모의 시스템을 달성할 수 있게 됨

But, 수백만 사용자 이상을 지원하려면 새로운 전략을 도입해야 하고 지속적으로 시스템을 가다듬어야 함.

ex) 시스템을 최적화하고 더 작은 단위의 서비스로 분할해야할 수도 있음

시스템 규모 확장을 위해 살펴본 기법들

- 웹 계층은 무상태 계층으로

- 모든 계층에 다중화 도입

- 가능한 한 많은 데이터를 캐시할 것

- 여러 데이터 센터를 지원할 것

- 정적 콘텐츠는 CDN을 통해 서비스할 것

- 데이터 계층은 샤딩을 통해 그 규모를 확장할 것

- 각 계층은 독립적 서비스로 분할할 것

- 시스템을 지속적으로 모니터링하고, 자동화된 도구들을 활용할 것